Was ist Funktionale Sicherheit eigentlich ?

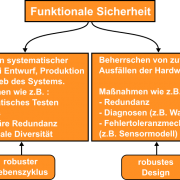

Funktionale Sicherheit, kurz FuSi oder FuSa (engl.) ist eine Art Produkteigenschaft welche mit umfangreichen Analysetätigkeiten und deren Dokumentation während der Entwicklung einhergeht. Funktionale Sicherheit wird nach der generischen Sicherheitsgrundnorm und in der Norm für den Automobilsektor wie folgt definiert:

Angelehnt an IEC 61508-Teil 4 bezeichnet Funktionale Sicherheit den wesentlichen Teil der Gesamtsicherheit eines Systems, der von der korrekten

Funktion des sicherheitsbezogenen E/E/PE-Systems und anderer risikomindernder Maßnahmen abhängt.

Angelehnt an ISO 26262-Teil 1 ist Funktionale Sicherheit die Fähigkeit eines elektrischen, elektronischen, programmierbar elektronischen Systems (E/E-System), beim Auftreten systematischer Ausfälle (z.B. fehlerhafte Systemauslegung) sowie zufälliger Hardwareausfälle (z.B. Alterung von Bauteilen) mit gefahrbringender Wirkung, einen wohl definierten sicheren Zustand einzunehmen bzw. in einem sicheren Zustand zu verharren.

Grundsätzlich können von einem System, Subsystem, einer Maschine, einem Aggregat, einem Bauteil, einer Software oder einer Hardware Fehlfunktionen ausgehen. Einige dieser Fehlfunktionen können zur Beeinträchtigung einer sicherheitsrelevanten Funktion bis zu einen gefahrbringenden Ausfall führen. Abstrakt handelt es sich um eine Abweichung von Funktionsparametern in den Dimensionen Zeit, Raum oder Wertebereich. Zum Beispiel hervorgerufen durch:

- eine zu große/kleine Drehzahl, welche zu früh/spät erkannt wird oder

- eine oszillierende Aktorik, welche zur destruktiven Resonanz führt oder

- ein zu spät eingeleitete Systemabschaltung oder

- keine Systemabschaltung oder

- Systemabschaltung, obwohl es zu keiner kommen darf oder

- eine falsche Berechnung oder

- ein korrupter Datensatz (z.B. Konstante, Referenzwert…)

Nicht jede Abweichung zur Normalfunktion ist eine potenzielle gefahrbringende Fehlerquelle. Der Mensch selbst kann als Fehlerquelle übrigens auch in Frage kommen oder die Maschine hat prozesstechnische Gefährdungsquellen. Es kommt auch auf die Systemcharakteristik bzw. den erreichbaren und haltbaren sicheren Systemzustand an. Eine Abschaltung von Triebwerken bei einem Flugzeug kann nicht direkt zu einen sicheren Zustand führen, wenn sich das Flugzeug in der Luft befindet. Im Gegensatz zum Flugzeug kann eine Abschaltung eines Elektromotors in einem E-Fahrzeug noch als tolerierbarer Zustand interpretiert werden. Funktionale Sicherheit ist nicht zu verwechseln mit elektrischer Sicherheit, Brandschutz oder Kontruktionselemente.

Folglich ist die Funktionale Sicherheit eine für den Kunden/Anwender/Endverbraucher i.d.R. nicht direkt geforderte funktionale Systemeigenschaft, sondern eine dem allgemeinen gesellschaftlichen und rechtlichen Sicherheits- und Qualitätsverständnis zugrundeliegende Systemeigenschaft, welche quasi der „System-Normalfunktion“ (bestimmungsgemäße Funktion) ergänzend hinzugefügt werden sollte. Dabei ist im Maschinenbau vorab zu trennen zwischen dem EUC = Equipment Under Control, also die Maschine, welche zusammen mit der Maschinensteuerung die „Normalfunktion“ ausführt und den dazu passend zu entwicklenden sicherheitsrelevanten Teilsystem, dem SRP = safety related part, welches die Normalfunktion zu einer sicheren Funktion ergänzt und eine Risikominderung im Hinblick auf eine identifizierte Gefährdung darstellt.

Systemcharakteristik (Fail-Safe / Fail-Operational) bestimmt Aufwände

Wie dieses sicherheitsrelevante Teilsystem beschaffen sein muss, ist von vielen Faktoren (z.B. Technologie, SIL …) abhängig und muss individuell durch systematische Analyse(n) der Normalfunktion entworfen werden. Oft kann eine grobe Klassifikation der sicherheitskritischen Systeme in Fail-Safe und Fail-Operational erfolgen. Fail-Safe bedeutet Sicherheit durch Deaktivierung der bestimmungsgemäßen Funktion. Fail-Operational bedeutet Sicherheit durch Erhalt der bestimmungsgemäßen Funktion. Damit wird deutlich, dass die Funktionale Sicherheit bei Fail-Safe-Systemen die Verfügbarkeit der bestimmungsgemäßen Funktion einschränkt. Im Allgemeinen sind Sicherheitsziele zu definieren. Bei einer Industrieanlage kann dies der Schutz eines Reaktors sein, bei einer Lenkung im Fahrzeug kann dies die Verhinderung eines Fehllenkens sein, bei einer Maschine die Anwesenheitserkennung einer Person in einen überwachten Gefahrenbereich sein oder beim Flugzeug kann es der Erhalt der steuerbaren Turbinenvorschubkraft sein.

Funktionale Sicherheit ist kurz gesagt, eine Identifikation der Gefahrenquellen, eine Beurteilung der Gefährdung und die Risikominderung durch eine Implementierung einer geeigneten Sicherheitsfunktion (SF) mit ausreichend Integrität durch aktive Vermeidung systematischer Fehler im Entwicklungsprozess und die Quantifizierung der Ausfallwahrscheinlichkeit der Komponenten.

Hat das System Schnittstellen zur Kommunikation, so ist auch das Thema „Security“ für die Erhaltung der Integrität relevant. Dies ist jedoch über andere Standards z.B. zur IT Sicherheit ausserhalb der Funktionalen Sicherheit zu gewährleisten. Man merke, Functional Safety (Funktionale Sicherheit) ist nicht Security.

Hier sei angemerkt, dass der Begriff „Normalfunktion“ hier nur der Erklärung dienlich ist und nicht mit den Safety-Standards in Beziehung steht. Im Automotive-Bereich ist es vergleichbar mit der „Item-Definition“. Im Maschinenbereich ist dies die bestimmungsgemäße Funktion.

Warum wird Funktionale Sicherheit angewandt ?

Im Grunde ist die Anwendung der FuSi rechtlich begründet. Der Ursprung dieser rechtlichen Grundlagen sind Katastophen wie Seveso (Industrieanlage in Italien mit Störfall (Dioxin wurde freigesetzt)), Zugunfälle, Atomstörfälle, Flugzeugabstürze. Aufsichtsbehörden sind oft beteiligt an der Entstehung dieser Normen. Teils wird auch die Funktionale Sicherheit als Markteintrittsbarriere wahrgenommen. Imageschäden aus Sicherheitsvorfällen mit Absatzschäden sensibilisiert die Industrie zur Normungsmitarbeit und Anwendung. Die Anwendung wird daher primär zu Vermeidung von Schäden durch fehlerhafte Produkte und die Haftungsfrage getrieben. Ausgehend von der europäischen Ebene finden sich im Rahmen der Rechtsvorschriften zum Inverkehrbringen oder Bereitstellen von Produkten auf dem europäischen Binnenmarkt z.B. folgende Richtlinien für die Artikel 95 (Freier Warenverkehr) und 137 (Arbeitsschutz) des EG-Vertrages:

- Produktsicherheitsverordnung EU 2023/988

- für elektrische Betriebsmittel zur Verwendung innerhalb bestimmter Spannungsgrenzen – Niederspannungsrichtlinie (NRL) – 2014/35/EU

- über Maschinen (MRL) 2006/42/EG (bald abgelöst durch die Maschinenverordnung)

- Medizinprodukteverordnung EU 2017/745

- über die Benutzung von Arbeitsmitteln – Arbeitsschutz-Rahmenrichtlinie– 89/391/EWG

- zur Beherrschung der Gefahren schwerer Unfälle mit gefährlichen Stoffen – Seveso III oder auch Störfallrichtlinie – 2012/18/EU

Richtlinien werden i.d.R. über nationale Gesetze in geltendes Recht im jeweiligen Mitgliedsstaat umgesetzt. Neben den Richtlinien sind EU-Verordnungen unmittelbar bindend, ohne nationale Gesetzentwürfe.

Die Produkthaftung ist in der Bundesrepublik Deutschland nach dem Produkhaftungsgesetz (ProdHaftG) geregelt und wird durch das Produktsicherheitsgesetz (ProdSG) ergänzt, welches wiederum nationales Recht nach der Produktsicherheitsrichtlinie 2001/95/EG bzw. der Produktsicherheitsverordnung darstellt. Das ProdSG stellt Anforderungen an die Produktsicherheit, um die Sicherheit und Gesundheit von Personen bei Verwendung der Produkte zu gewährleisten. Mit Verweis auf Standards und harmonisierte Normen in § 4 ProdSG schließt sich der Kreis zur weiteren Richtlinien wie z.B. der Maschinenrichtlinie oder auch bald der 9. Verordnung (Maschinenverordnung).